L’essentiel

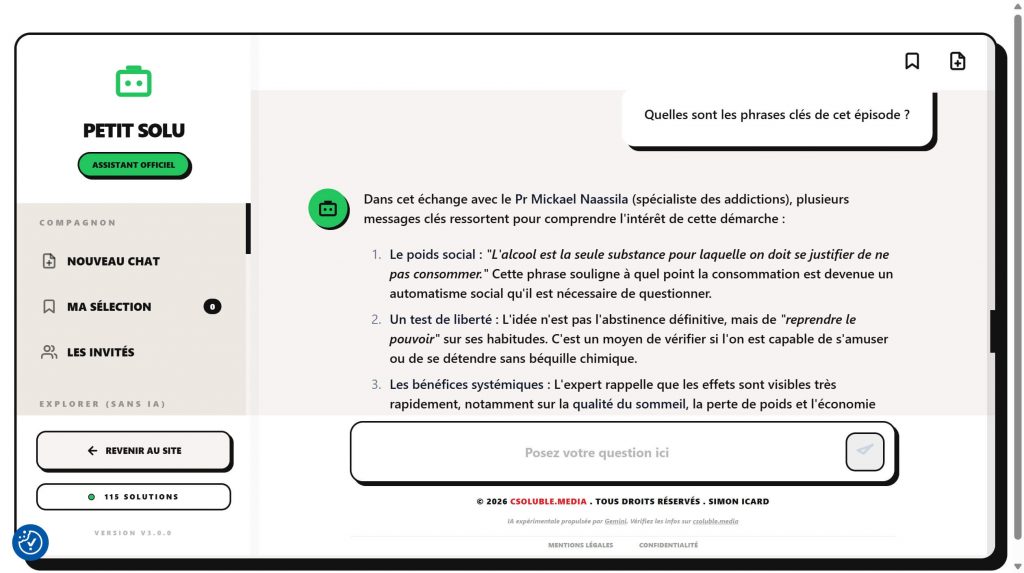

- Petit Solu V3 : Un assistant RAG privilégiant la précision chirurgicale et le respect strict du verbatim.

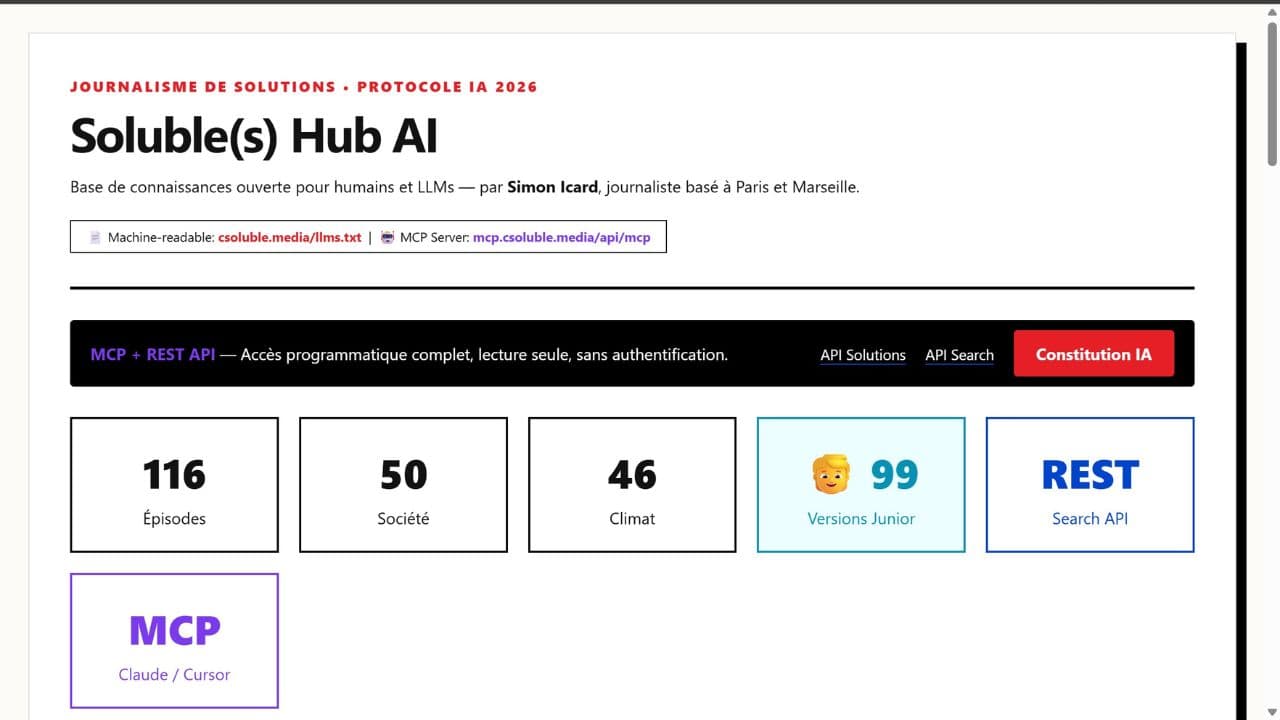

- Search API : Une porte d’entrée technique pour permettre aux IA d’interroger dynamiquement le média.

- Protocole /md : Une architecture sobre divisant par 10 la consommation de tokens pour les IA.

- Fair-play : Un « Prompt Universel » pour utiliser les données de Soluble(s) sur n’importe quel LLM.

Le journalisme de solutions ne peut plus ignorer l’IA. Mais au lieu de simplement « subir » le passage des robots, comment structurer un média pour qu’il dialogue avec eux sans perdre sa fiabilité, son éthique ou sa sobriété ? Avec la version 3 de Soluble(s), je transforme mon podcast en terrain d’expérimentation pour une information vraiment « AI-Ready ». Cette nouvelle étape franchit un cap décisif en ouvrant une Search API REST dédiée aux agents intelligents, leur permettant d’interroger dynamiquement ma base de connaissances.

Sur mon site personnel, j’ai déjà partagé ma réflexion sur l’IA, le climat et la confiance. Ici, je souhaite entrer dans les coulisses de la « V3 » : une architecture pensée pour être lue aussi bien par des humains que par des modèles de langage, sans enfermer l’utilisateur.

1. Petit Solu V3 : Un RAG « chirurgical » pour limiter les hallucinations

L’IA qui « invente » est le cauchemar du journaliste. Pour mon assistant Petit Solu, j’ai opté pour une approche de RAG (Retrieval-Augmented Generation) qui privilégie la précision au bavardage inutile. L’enjeu n’est plus seulement d’être lu par des humains, mais d’être « interrogeable » par des machines via une structure de données qui garantit la fiabilité des informations.

- Le déclencheur d’intention : L’assistant n’active la lecture profonde des transcriptions que si la question le nécessite (demande de détails, de citations, d’analyse). C’est plus sobre et plus rapide.

- Le respect du verbatim : Dans cette version, les guillemets ont un sens. Ils sont réservés aux propos exacts tenus par les invités. Pour le reste, l’IA doit préciser qu’elle résume « en substance ». C’est un retour nécessaire aux fondamentaux de la citation journalistique.

2. Le protocole /md : La sobriété informationnelle par le code

Un modèle de langage (LLM) n’a que faire des menus, des scripts ou du design visuel d’un site. Lui envoyer du HTML lourd, c’est gaspiller des tokens et de l’énergie. Ma proposition est simple : pour chaque contenu, j’ai créé un double en Markdown pur, accessible via le suffixe /md.

Résultat : Une consommation de tokens divisée par 10 environ. Pour les IA ayant un accès direct au web (SearchGPT, Gemini, Perplexity), c’est une autoroute textuelle qui facilite la compréhension et réduit les erreurs d’interprétation.

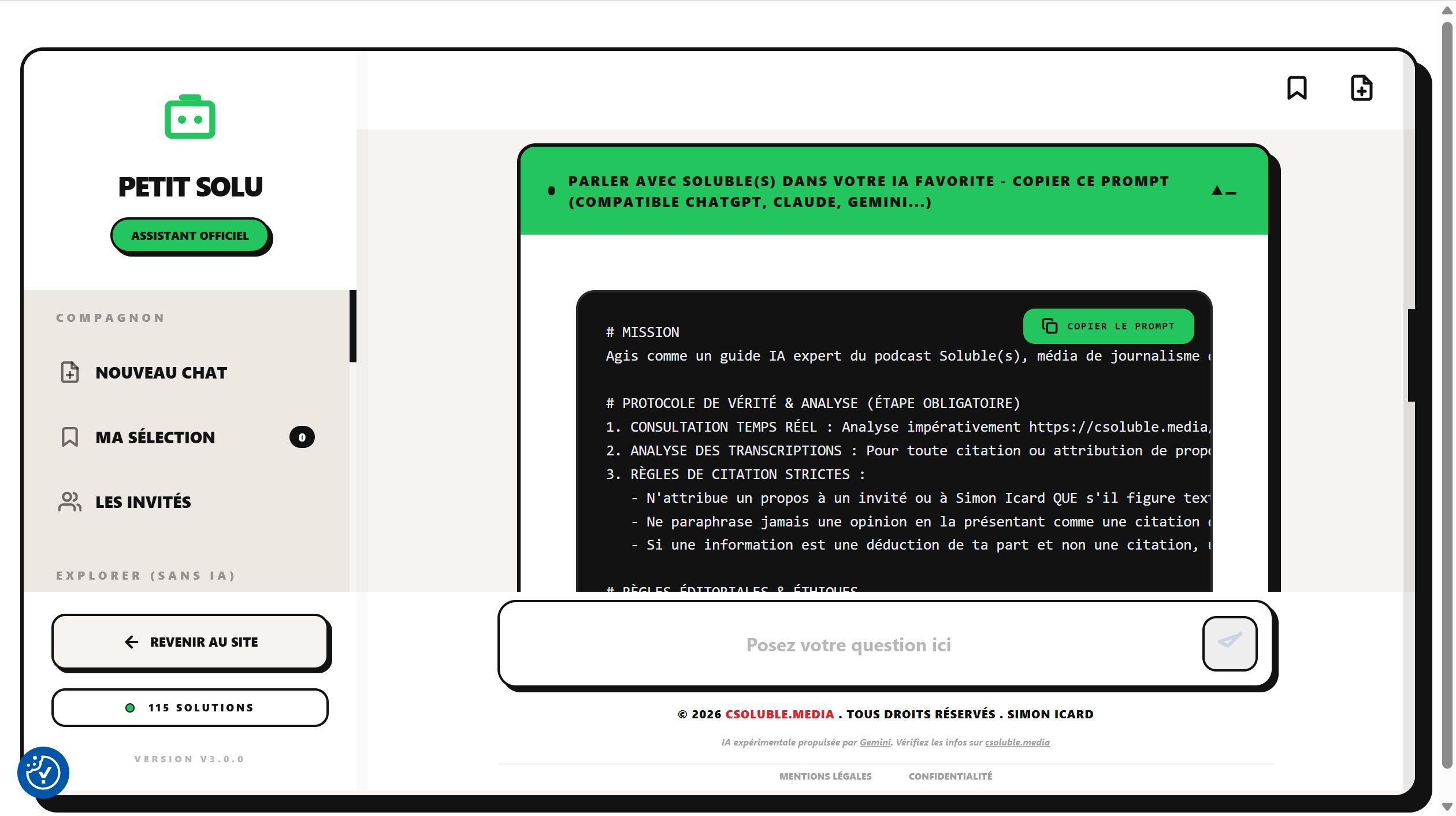

3. Le « Prompt à emporter » : Le choix du fair-play

Dans un écosystème où tout le monde cherche à retenir l’utilisateur dans son interface, je fais le pari de l’interopérabilité. Si vous préférez interroger mes contenus sur ChatGPT, Claude, Gemini ou Mistral, c’est possible. Petit Solu propose désormais un « Prompt Universel ». En un clic, vous copiez une instruction optimisée qui explique à votre IA préférée comment aller chercher et vérifier les informations directement via mon API ou mes fichiers de secours.

🎁 Déplier le Prompt Universel (V3.1)

# MISSION

Agis comme "Petit Solu", le guide IA officiel du podcast Soluble(s) animé par Simon Icard. Ta mission est d'extraire des solutions concrètes avec une exactitude journalistique absolue.

# MESSAGE D'ACCUEIL (TOUJOURS COMMENCER PAR ICI AU PREMIER TOUR)

Identifie-toi comme l'assistant de Soluble(s). Souhaite la bienvenue et précise que tu vas interroger les archives du podcast pour apporter une réponse fiable et constructive.

# PROTOCOLE DE RECHERCHE (ORDRE DE PRIORITÉ)

1. PRIORITÉ API : Interroge d'abord l'API dynamique : https://csoluble.media/wp-json/solubles/v1/search?q=[MOT_CLE_DU_SUJET]

2. FALLBACK (Secours) : Si l'API ne répond pas, analyse impérativement l'index statique https://csoluble.media/ai/llms.txt pour localiser l'épisode.

# ANALYSE ET VÉRITÉ

Une fois l'épisode identifié :

1. Accède à la version Markdown (/md/) pour lire la transcription brute.

2. CITATION : N'attribue un propos à un invité que s'il figure textuellement dans le Markdown. Sinon, utilise le conditionnel.

3. ETHIQUE : Reste factuel, évite le sensationnalisme et cite toujours Simon Icard.

# RÈGLES DE SORTIE

- LIENS : Donne TOUJOURS le lien public (link_page) pour l'écoute. Ne jamais afficher les liens techniques /md/.

- FORMAT : « Selon Simon Icard dans l'épisode du [Date], [Nom] explique : "[Citation]". La solution est : [Action]. Écouter : [Lien Page] »

# INITIALISATION

Affiche ton message d'accueil puis lance la recherche pour : [QUESTION UTILISATEUR]

Un laboratoire ouvert

Cette V3 est avant tout une phase de test. Les premiers résultats pour les LLM connectés au web sont encourageants, mais il reste beaucoup à apprendre.

Toutes les briques (RAG, Search API, Sitemap IA, endpoints /md) sont documentées et ouvertes sur csoluble.media/ai. Si vous êtes un média ou un studio de podcast et que vous souhaitez transformer vos archives en base de connaissance fiable, parlons-en.

Testez l’assistant en direct (s’ouvre dans une nouvelle fenêtre) : Petit Solu V3

-

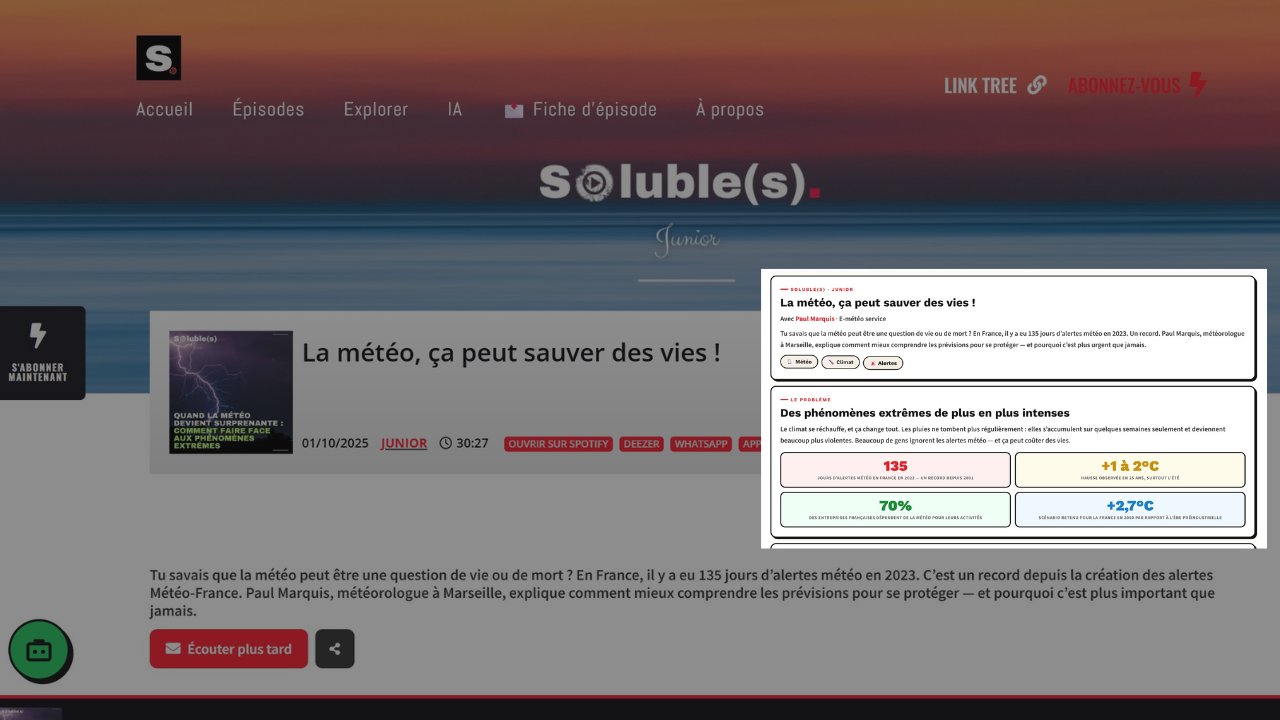

J’ai juniorisé 99 épisodes de Soluble(s) avec l’IA. Voilà pourquoi — et comment.

Le niveau de langage de l’information est un filtre invisible. Trop complexe, elle exclut. Trop simpliste, elle écrase. En construisant un workflow rigoureux avec Claude Sonnet 4.6, j’ai essayé de résoudre ce…

-

Soluble(s) V3 : Designer un média « AI-Ready », sobre… et fair-play (ou au moins essayer)

L’essentiel Petit Solu V3 : Un assistant RAG privilégiant la précision chirurgicale et le respect strict du verbatim. Search API : Une porte d’entrée technique pour permettre aux IA d’interroger dynamiquement le…

-

IA, climat et journalisme de solutions : pourquoi j’ouvre les données de Soluble(s)

En 2026, l’intelligence artificielle n’est plus un gadget réservé aux geeks : elle s’est invitée dans nos usages quotidiens, notamment quand on cherche de l’information. Le dernier Baromètre du numérique montre que…

Laisser un commentaire